你的爬虫是不是经常被网站识别并封禁IP?采集到的数据质量差,效率低,还冒着被封号的风险?为什么同样的爬虫脚本,别人的成功率能达到90%,而你的只有30%?问题很可能出在你的IP策略上。

我们服务过3000+爬虫团队,发现一个残酷事实:超过80%的爬虫失败不是因为脚本问题,而是IP管理不当。你有没有遇到过这些情况:

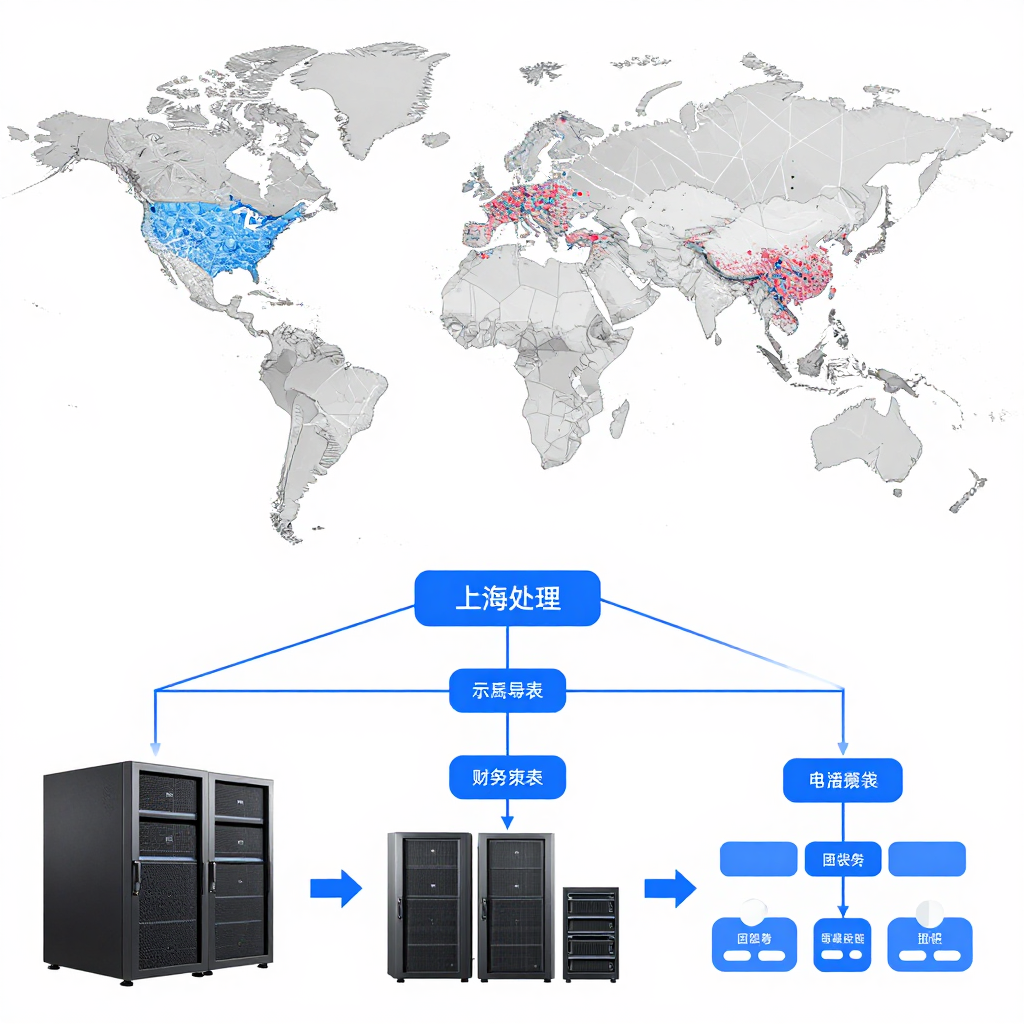

这些问题,一套全球节点IP策略全都能解决。但不是随便买个IP就能用,99%的人都踩过这些坑。

不要盲目追求节点数量。我们测试过,10个高质量节点的采集效率,往往超过100个低质量节点。关键看三点:

实操建议:根据采集目标选择核心区域节点。比如采集美国电商数据,至少需要5-8个美国主要城市节点;如果是全球数据采集,建议每个目标区域3-5个节点,总数控制在20-30个为宜。

很多客户以为多买几个IP就能解决问题,结果还是被封。真正的关键在于轮换策略:

具体配置:

```python

import requests

from ipip123 import IPIP123Client # 假设的IP代理客户端

client = IPIP123Client(api_key='your_api_key')

ip_info = client.get_ip(country='US', region='California')

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

'X-Forwarded-For': ip_info['ip']

}

response = requests.get('https://target-website.com', headers=headers)

```

不要犯的错误1:使用同一个IP采集多个相关网站

- 后果:网站间数据互通,极易识别爬虫行为

- 正确做法:每个网站使用不同的IP段

不要犯的错误2:固定IP顺序轮换

- 后果:形成可识别的访问模式

- 正确做法:随机选择IP,避免规律性

不要犯的错误3:忽略IP的HTTPS支持

- 现代网站基本全站HTTPS,不支持HTTPS的IP等于无用

- 确保你的IP节点支持HTTPS协议

很多工作室老板觉得全球IP贵,我们来算一笔账:

方案对比:

- 免费代理:成本¥0,成功率10%,被封风险90%

- 廉价代理:成本¥100/月,成功率30%,被封风险60%

- 专业全球IP:成本¥500-1000/月,成功率85%+,被封风险<10%

投资回报分析:

假设你是一个3人团队,月目标采集100万条数据:

净收益差距:¥130,000

记住,全球节点IP不是万能药,但它是你爬虫项目的"保命符"。正确的IP配置能让你的采集效率提升3-5倍,大幅降低被封风险。

现在就去检查你的IP策略吧,别等到账号被封才后悔莫及!